Corrélation causalité IA : biais algorithmiques et rôle de l'humain

IA en entreprise Corrélation vs causalité Responsabilité humaine

1Comprendre le grand malentendu corrélation/causalité

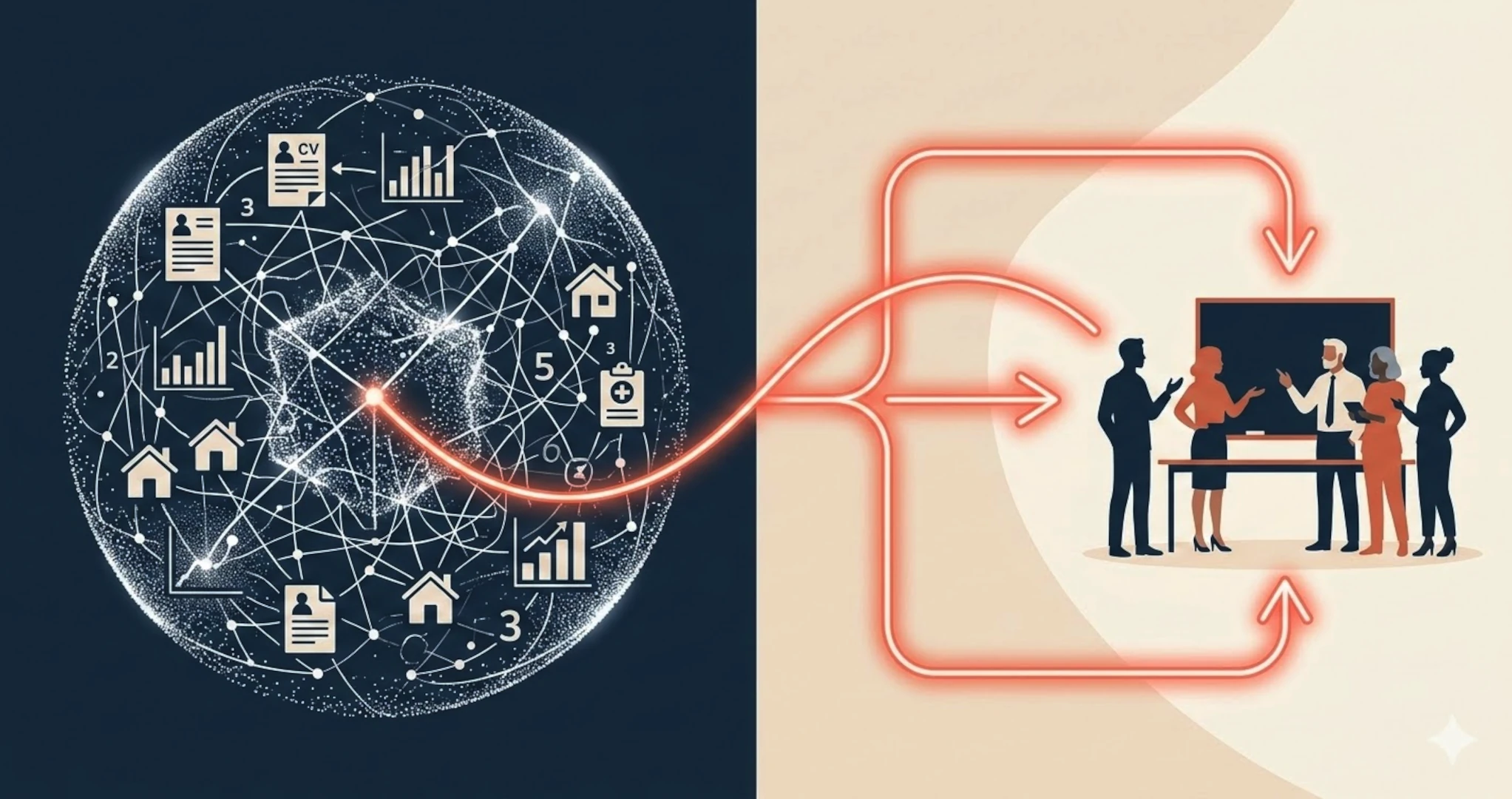

En entreprise, l'IA arrive souvent avec une promesse simple : prédire, donc mieux décider. Trier plus vite, prioriser plus juste, réduire les erreurs. Le hic, c'est que la majorité des modèles déployés au quotidien sont des machines à corréler. Ils apprennent ce qui va souvent ensemble, puis ils l'utilisent pour classer, scorer, recommander. Le problème n'est pas la corrélation. Le problème, c'est la confusion entre ce qui est associé et ce qui cause.

Un rappel léger suffit. On peut trouver une corrélation entre consommation de chocolat et nombre de prix Nobel. Cela ne prouve pas que le chocolat cause des prix Nobel. Cela révèle surtout d'autres facteurs en arrière-plan, comme la richesse, l'accès à l'éducation, l'investissement en recherche. Même logique pour glaces et noyades : l'été et l'affluence créent un lien statistique, pas une cause directe.

Pourquoi c'est un sujet éthique. Parce que, quand une IA classe des humains, une corrélation peut devenir une règle de décision. Et une règle de décision peut produire des injustices tout en gardant une apparence d'objectivité.

Titre du cas : Un score de risque qui devient une vérité

Ce qui s'est passé : Une organisation déploie un scoring pour "réduire les impayés". Le score, au départ indicatif, devient un filtre. En dessous d'un seuil, le dossier est refusé.

Impact humain : Des personnes sont refusées sans comprendre. Certaines renoncent. D'autres se sentent suspectées et perdent confiance.

Risque identifié : Discrimination indirecte via variables proxy (adresse, historique incomplet) et perte d'autonomie par automatisation.

Comment c'est détecté : Analyse des refus après hausse des réclamations, puis audit des écarts par zones et profils.

- Une corrélation dit "ça varie ensemble", pas "ça provoque".

- Un modèle peut être performant sans comprendre les mécanismes.

- Dès qu'un score déclenche une action sur quelqu'un, il faut des garde-fous.

2Corrélation vs causalité : en langage clair

Corrélation : un signal utile, parfois trompeur

La corrélation, c'est un thermomètre. Elle signale un lien statistique entre deux phénomènes. Elle ne donne pas le pourquoi. Elle est utile pour repérer des tendances, détecter des anomalies, segmenter une base. Elle devient risquée quand on l'utilise comme si elle expliquait le monde.

Exemple métier. "Délai de réponse" et "satisfaction" peuvent corréler. Agir sur le délai peut aider. Mais la cause réelle peut aussi être le ton, le manque d'information, ou la complexité du parcours. Une corrélation peut cacher plusieurs histoires.

Causalité : agir pour changer, sans promettre la certitude

La causalité répond à une autre question : si on change X, est-ce que Y change. On s'en approche via des hypothèses testées, des designs rigoureux (tests A/B quand c'est possible, quasi-expériences quand ce ne l'est pas), et des méthodes contrefactuelles. On réduit l'incertitude, on ne la supprime pas.

Facteur confondant : la mécanique qui piège tout le monde

Le facteur confondant influence X et Y à la fois. C'est lui qui fabrique des corrélations trompeuses. En IA, il est souvent social ou organisationnel : accès à un service, contexte local, priorités internes, pratiques passées, effets de saison, contraintes de temps.

Facteur confondant : élément qui explique deux phénomènes à la fois, et qui vous fait croire que l'un cause l'autre.

Proxy : quand un détail remplace une réalité complexe

Un proxy est un indice indirect. Un code postal peut refléter un contexte socio-économique et un accès différent aux services. Un historique d'utilisation d'un service peut refléter des barrières d'accès, pas un manque de besoin. Le modèle optimise ce qui prédit dans les données, même si cela reproduit des inégalités.

Proxy : variable qui permet de deviner autre chose. Parfois utile. Parfois dangereuse quand elle sert à décider.

3Comment l'IA exploite surtout des corrélations

Ce que fait un modèle standard

Un modèle de machine learning reçoit des exemples, une cible à prédire, et il optimise une métrique. Il n'a pas besoin de comprendre le monde. Il apprend des associations. S'il existe un raccourci prédictif, comme un proxy, il a de bonnes chances de le choisir.

Souvent, l'organisation lui demande de prédire une cible qui n'est déjà pas neutre. "Bon employé", "bon client", "dossier prioritaire" sont des labels construits par un système humain. Si l'historique reflète une préférence, une sous-déclaration, une inégalité d'accès, le modèle l'apprend. Et comme on mesure souvent la performance globale, on peut obtenir un modèle "meilleur" tout en aggravant les écarts pour certains profils.

Pourquoi la causalité ne vient pas toute seule

Un modèle standard est excellent pour répondre à "qu'est-ce qui ressemble à quoi". Il est beaucoup moins équipé pour répondre à "qu'est-ce qui provoque quoi". La causalité demande de représenter des hypothèses sur les relations cause-effet, et de tester ces hypothèses. Autrement dit, elle demande une intention de compréhension, pas seulement une optimisation.

| Lecture prédictive | Lecture causale |

|---|---|

| Question : "Que va-t-il probablement se passer ?" | Question : "Que se passe-t-il si j'interviens ?" |

| Force : repère des motifs, même faibles. | Force : aide à décider sur des leviers, pas seulement sur des scores. |

| Risque : confond association et mécanisme, utilise des proxys. | Risque : dépend des hypothèses, des variables observées, et de la gouvernance. |

Important : une approche causale réduit certains pièges statistiques. Elle ne remplace pas la vigilance éthique ni la supervision humaine.

Mini-scénario : tri de CV, efficacité et angle mort

Une PME reçoit 700 candidatures. Elle déploie un outil IA pour classer les CV, entraîné sur des recrutements passés. Il apprend que certaines écoles et certains mots-clés corrèlent avec "réussite" selon les critères internes.

Le résultat est fluide : shortlist rapide, temps gagné. Mais les profils atypiques sortent du radar, parce que le modèle réplique ce qui a déjà été valorisé, pas ce qui pourrait réussir demain.

Mini-scénario : recommandation de contenus et boucle d'attention

Une créatrice publie des contenus variés. La plateforme observe que les formats polarisés retiennent davantage l'attention. L'algorithme recommande plus souvent ce format. La créatrice s'adapte. Le système "prouve" alors que ce format est ce que le public veut, alors qu'il a influencé la demande.

Corrélation qui vieillit : quand le contexte bouge

Les corrélations vieillissent. Quand le contexte change (marché, politique interne, crise, saisonnalité), un signal qui marchait hier peut devenir trompeur. Sans suivi, on conserve le même score, mais il ne mesure plus la même réalité. La corrélation peut rester "bonne" sur un tableau de bord, alors que la cause a bougé.

Et l'IA générative

Les modèles génératifs produisent des explications plausibles parce qu'elles ressemblent à ce qui a déjà été écrit. Une explication fluide n'est pas une justification causale. Le risque est simple : accepter une décision injuste parce qu'elle est bien racontée.

4Là où tout dérape : biais, corrélations trompeuses et impacts humains

Quatre portes d'entrée des biais

Quand un système d'IA devient injuste, la cause est rarement unique. Voici quatre portes d'entrée fréquentes. Elles peuvent coexister et se renforcer.

- 1) Biais de données : l'historique reflète des pratiques et des inégalités passées.

- 2) Biais de conception : variables choisies, objectif d'optimisation, seuils, métriques, tout cela est humain.

- 3) Biais de mesure et de sélection : ce qu'on mesure n'est pas ce qu'on vise, et qui entre dans la base n'est jamais neutre.

- 4) Biais de déploiement et boucles de rétroaction : le score change les comportements, puis les données futures, puis le modèle se renforce.

Ces catégories sont très présentes dans les cadres de gestion des risques qui insistent sur la nature socio-technique de l'IA et sur l'importance du contexte d'usage, pas seulement du modèle.

Titre du cas : Code postal, logistique au départ, exclusion à l'arrivée

Ce qui s'est passé : Un service automatise l'éligibilité. Le code postal est présent pour l'opérationnel. Dans l'historique, certains quartiers ont plus d'incidents. Le modèle apprend "quartier" = "risque".

Impact humain : Des personnes sont refusées alors qu'elles répondent aux critères réels. Elles perçoivent une injustice, et la relation se dégrade.

Risque identifié : Discrimination indirecte via proxy territorial et amplification d'inégalités.

Comment c'est détecté : Analyse d'écarts par zone, puis tests de sensibilité en retirant des proxys et en comparant les sorties.

Mini-scénario : scoring commercial et prophétie

Une équipe reçoit un score "probabilité d'achat". Les scores élevés sont appelés en premier. Les scores bas ne sont presque plus contactés. Le modèle "prouve" ensuite que les scores bas achètent rarement, mais l'usage a contribué à créer ce résultat. Les clients concernés subissent une inégalité d'attention.

Biais de mesure : quand on confond "facile à mesurer" et "ce qui compte"

Dans la vraie vie, on remplace souvent une réalité complexe par un indicateur plus simple. Exemple classique en santé : certains systèmes ont utilisé le coût futur comme proxy du besoin médical. Or, si l'accès aux soins diffère selon les populations, le coût ne reflète pas le besoin de façon équitable. Un cas documenté montre comment ce choix de proxy peut générer des biais importants, tout en restant "prédictif" selon certaines métriques.

Une corrélation peut être vraie et inacceptable

"Distance domicile-travail" peut corréler avec la ponctualité. Utiliser ce signal comme filtre pénalise des personnes qui n'ont pas les mêmes contraintes, ni les mêmes opportunités de logement. Le modèle voit un motif. L'organisation décide si ce motif a le droit d'entrer dans la décision.

Mini-scénario santé : peu de données, donc peu de priorité

Un outil de tri corrèle "peu de consultations" avec "faible gravité". Or, certaines personnes consultent moins pour des raisons d'accès, de temps, de langue, ou de confiance. Le modèle confond "peu de traces" avec "peu de besoin". Le risque devient un retard de prise en charge.

Mini-scénario assurance : l'effet incitatif

Une assurance ajuste un tarif à partir d'un score de risque. Les assurés comprennent que certaines déclarations font monter le score. Une partie d'entre eux change de comportement et déclare moins, pas parce que le risque a baissé, mais parce que l'incitation a changé. Le modèle voit une corrélation qui se déforme. La cause, elle, inclut l'effet du dispositif sur le comportement.

- Le gain de productivité est souvent collectif.

- Le coût d'un faux négatif ou d'un faux positif est souvent individuel.

- C'est pour cela qu'on ne peut pas piloter un modèle uniquement avec une métrique globale.

La question à garder en tête est simple : qui paie le coût des erreurs, et qui a un recours quand l'outil se trompe.

5Pourquoi cette confusion est éthiquement problématique

L'illusion d'objectivité déplace la responsabilité

Quand un score est présenté comme "neutre", on oublie les choix humains : objectif, données, seuils, arbitrages entre performance et équité. La phrase "le modèle a décidé" transforme une décision en fatalité statistique.

Expliquer utilement, c'est donner une prise

Une personne a besoin de comprendre ce qui a pesé, ce qu'elle peut corriger, et comment contester. Si le système repose sur des proxys opaques, l'explication devient fragile. Plus la décision est importante, plus c'est grave.

Ce que le cadre européen change concrètement

En Europe, plusieurs textes et lignes directrices structurent la manière d'aborder les décisions automatisées et les systèmes d'IA. Le règlement européen sur l'IA (AI Act) est entré en vigueur le 1er août 2024. Il suit une application progressive, avec des jalons publics, et impose des obligations plus fortes pour certains usages, notamment ceux considérés à haut risque.

- 2 février 2025 : interdictions de certaines pratiques + obligations de culture IA ("AI literacy").

- 2 août 2025 : obligations de gouvernance + règles sur les modèles d'IA à usage général (GPAI).

- 2 août 2026 : application générale (avec exceptions sectorielles).

- Jusqu'au 2 août 2027 : transition pour certains systèmes "high-risk" intégrés à des produits régulés.

Ces attentes se retrouvent aussi dans les recommandations des autorités de protection des données — notamment la CNIL — sur le développement et l'usage de systèmes d'IA impliquant des données personnelles.

- 1) Cartographier l'usage : quel outil, quel objectif, qui est impacté, à quel moment.

- 2) Qualifier le risque : décision sensible, effets significatifs, secteur, et usage réel (conseil ou filtre).

- 3) Documenter les choix : données, variables, cible, seuils, et justification métier.

- 4) Tester au-delà de la précision : écarts d'erreurs, dérive dans le temps, et scénarios limites.

- 5) Organiser la supervision : droit d'intervention, consignes d'escalade, et conditions d'arrêt.

- 6) Organiser le recours : explication utile, contestation, et délai de traitement.

Métriques d'équité : nommer les choix, assumer les compromis

Pour agir, il faut nommer ce qu'on mesure. Voici quatre repères simples, souvent utilisés en pratique.

Taux de faux négatifs par sous-groupe : qui est injustement exclu.

Égalité des chances (equal opportunity) : même taux de vrais positifs entre groupes.

Égalisation des odds (equalized odds) : mêmes taux de vrais positifs et de faux positifs entre groupes.

Calibration : un score de 0,7 signifie la même probabilité réelle, quel que soit le groupe.

Point crucial : ces notions sont souvent incompatibles entre elles quand les taux de base diffèrent entre groupes. Il faut donc choisir, documenter, et assumer un compromis, plutôt que de déléguer cet arbitrage à une métrique unique.

- Une corrélation devient un enjeu éthique dès qu'elle déclenche une action sur une personne.

- La responsabilité ne se délègue pas à un score.

- Le bon test est : peut-on expliquer, corriger, et contester.

6Outil diagnostic : vos usages confondent-ils corrélation et causalité ?

Checklist rapide, pensée pour des professionnels. L'objectif est de repérer les cas où un modèle transforme une corrélation en règle de décision, puis de choisir des garde-fous proportionnés.

- Étape 1 : Décrivez la décision, l'impact, et le coût d'une erreur (faux positif, faux négatif).

- Étape 2 : Vérifiez la cible : résultat réel, ou proxy (et si oui, lequel).

- Étape 3 : Listez les signaux. Repérez les proxys possibles (territoire, historique d'accès, indicateurs trop "faciles").

- Étape 4 : Question contrefactuelle : si on change ce signal sans changer la réalité, est-ce acceptable que la décision change.

- Étape 5 : Cherchez un confondant : facteur social, organisationnel, ou historique qui pourrait expliquer la corrélation.

- Étape 6 : Testez l'équité : au minimum, comparez faux négatifs et faux positifs par sous-groupes. Choisissez une métrique d'équité cible (opportunité, odds, calibration) et documentez ce choix.

- Étape 7 : Organisez le recours : contestation, délai, preuves, arbitre, et correction du dossier.

- Étape 8 : Clarifiez l'usage réel : conseil ou règle. Donnez un droit explicite de contredire le modèle, avec des cas d'école.

Si vous découvrez une cible proxy, des signaux proxy, et une absence de recours, le problème est souvent la gouvernance plus que le modèle. Et c'est une correction rentable.

7Passer à l'action

Commencez par remplacer "notre IA est objective" par des questions concrètes : quels signaux, quels impacts, quels tests d'équité, quels recours, quelle supervision. C'est la base d'un usage responsable.

Besoin d'un accompagnement ?

📌 Cas d'usage : Voir les exemples d'intervention

🧭 Audit GEO : Rendre vos contenus "citables" par les IA

📞 Consultation : Audit IA ou conformité AI Act

Prendre rendez-vous →8FAQ

- Quelle est la différence entre corrélation et causalité en IA, en une phrase ?

- La corrélation dit que deux phénomènes varient ensemble. La causalité dit qu'une intervention sur une variable change réellement une autre variable, dans un cadre d'hypothèses et de tests. Beaucoup d'IA prédisent via corrélations, ce qui ne suffit pas pour justifier une décision sur des humains.

- Pourquoi une IA peut-elle discriminer sans utiliser de données sensibles ?

- Parce que des proxys peuvent rester, comme certains indicateurs territoriaux, des historiques d'accès, ou des variables de parcours. Le modèle exploite ce qui prédit dans l'historique, même si cela reproduit des inégalités.

- Comment détecter rapidement si un modèle repose sur des proxys ?

- Listez les variables, puis posez une question contrefactuelle : "si je change ce signal sans changer la réalité, est-ce acceptable que la décision change". Si la réponse est non, le signal est suspect. Ensuite, testez les écarts d'erreurs selon des sous-groupes pertinents.

- Qu'est-ce qu'une supervision humaine réelle ?

- C'est une supervision qui peut arrêter, corriger, et justifier. Elle suppose des seuils, une procédure de recours, et une culture qui autorise le désaccord avec le modèle. Une supervision "symbolique" ne change pas l'impact.

- Pourquoi ne peut-on pas "optimiser toutes les équités" en même temps ?

- Parce que certaines définitions d'équité sont mathématiquement incompatibles quand les taux de base diffèrent entre groupes. Il faut donc choisir une cible d'équité, expliquer le choix, et surveiller les effets.

9Conclusion

Sans culture de la causalité, on transforme des corrélations en pseudo vérités. Et ces pseudo vérités peuvent gouverner des vies. L'IA peut être utile, si on la remet à sa place : un outil statistique dans un monde de causes, de contextes, et de dignité.

"Tenir le volant" veut dire quelque chose de très concret, surtout le lundi matin.

- Droit de contredire : autoriser explicitement les équipes à ignorer le score dans des cas définis.

- Seuils d'arrêt : fixer des conditions de suspension si des dérives ou des écarts apparaissent.

- Audit planifié : vérifier régulièrement performance, dérive, et impacts par sous-groupes.

- Journalisation : conserver les décisions, versions de modèle, et signaux utilisés, pour pouvoir expliquer.

- Recours documenté : offrir une contestation compréhensible, accessible, avec un délai.

- Responsabilité nominative : identifier qui tranche, qui arbitre, et qui rend des comptes.

- Biais dans la reconnaissance faciale : pourquoi votre IA se trompe de visage — Comment les biais de données produisent des erreurs systématiques sur certains groupes.

- Cas d'usage : IA éthique et biais algorithmiques — Des exemples concrets d'intervention (RH, scoring, chatbots) et les garde-fous mis en place.

- GEO : votre site est-il prêt pour l'ère de l'intelligence artificielle ? — Comment structurer vos contenus pour être cité par Perplexity, ChatGPT Browse et Gemini.

- [1] Commission européenne, Entrée en vigueur du règlement sur l'IA, 1er août 2024.

- [2] Commission européenne, Façonner l'avenir numérique de l'Europe — calendrier d'application du règlement IA, repères 2025–2027.

- [3] EDPB / WP29, Prise de décision automatisée et profilage, lignes directrices WP251 rev.01, 2018.

- [4] CNIL, Développement des systèmes d'IA : recommandations pour respecter le RGPD, 22 juillet 2025, et check-list associée.

- [5] NIST, Artificial Intelligence Risk Management Framework (AI RMF 1.0), NIST AI 100-1, 2023.

- [6] OCDE, Recommandation du Conseil sur l'intelligence artificielle (OECD/LEGAL/0449), 2019.

- [7] UNESCO, Recommandation sur l'éthique de l'intelligence artificielle, 2021.

- [8] Obermeyer, Powers, Vogeli, Mullainathan, "Dissecting racial bias in an algorithm used to manage the health of populations", Science, 2019.

- [9] Barocas & Selbst, "Big Data's Disparate Impact", California Law Review, 2016.

- [10] Hardt, Price, Srebro, "Equality of Opportunity in Supervised Learning", NeurIPS, 2016.

- [11] Chouldechova, "Fair prediction with disparate impact", 2017.

- [12] Kleinberg, Mullainathan, Raghavan, "Inherent Trade-Offs in the Fair Determination of Risk Scores", 2016 (version conférence 2017).

Note de transparence : Cet article a été co-rédigé avec l'assistance de modèles d'IA générative (ChatGPT, OpenAI ; Claude, Anthropic). La structure, l'analyse, les choix éditoriaux et la validation finale ont été réalisés par l'autrice. L'autrice est spécialisée en éthique IA, détection des biais et déploiement responsable pour les PME.